Qwen3.6-Plus é o mais recente modelo de carro-chefe equilibrado da Alibaba Cloud no Model Studio, chegando logo após Reuters Foi relatado que o líder da Qwen, Junyang Lin, renunciou ao cargo. A documentação atual da Alibaba Cloud lista uma janela de contexto de 1.000.000 de tokens, modo de raciocínio misto ativado por padrão, entrada multimodal e preços a partir de 2 RMB por milhão de tokens de entrada na China continental para solicitações de até 256 mil tokens de entrada.

Funcionalidades e benchmarks do Qwen 3.6-Plus

Modo de contexto longo, precificação e raciocínio

A Alibaba Cloud posiciona o Qwen3.6-Plus como um modelo de referência que equilibra qualidade, velocidade e custo. Na documentação oficial do modelo, a versão estável é listada com uma janela de contexto de 1.000.000 de tokens, até 65.536 tokens de saída e um comprimento máximo de pensamento de 81.920 tokens no modo de reflexão; a mesma documentação também mostra que o modo de reflexão está ativado por padrão.

A mesma documentação mostra que o Qwen3.6-Plus oferece suporte. texto, imagem e vídeo A entrada de dados é importante porque leva o modelo além da mera geração de texto, para a análise multimodal. Isso o torna mais relevante para fluxos de trabalho como compreensão de interfaces gráficas, análise de documentos e raciocínio multimídia, e não apenas para bate-papo padrão ou preenchimento automático de código.

Codificação e posicionamento multimodal

A documentação do produto da Alibaba descreve o Qwen 3.6-Plus como robusto em compreensão de linguagem, raciocínio lógico, geração de código, tarefas de agentes, compreensão de imagens, compreensão de vídeos e tarefas de interface gráfica. A página oficial de lançamento do Qwen também apresenta o modelo como uma forma de aprimorar agentes de codificação, agentes em geral e o uso de ferramentas por meio de uma integração mais estreita entre raciocínio, memória e interação com ferramentas.

Esse posicionamento sugere um modelo voltado para a execução prática, em vez de simples demonstrações de resposta rápida. Em termos editoriais, é mais preciso descrever o Qwen3.6-Plus como um modelo de agente e programação hospedado do que como um chatbot de propósito geral com um modo de programação adicionado posteriormente.

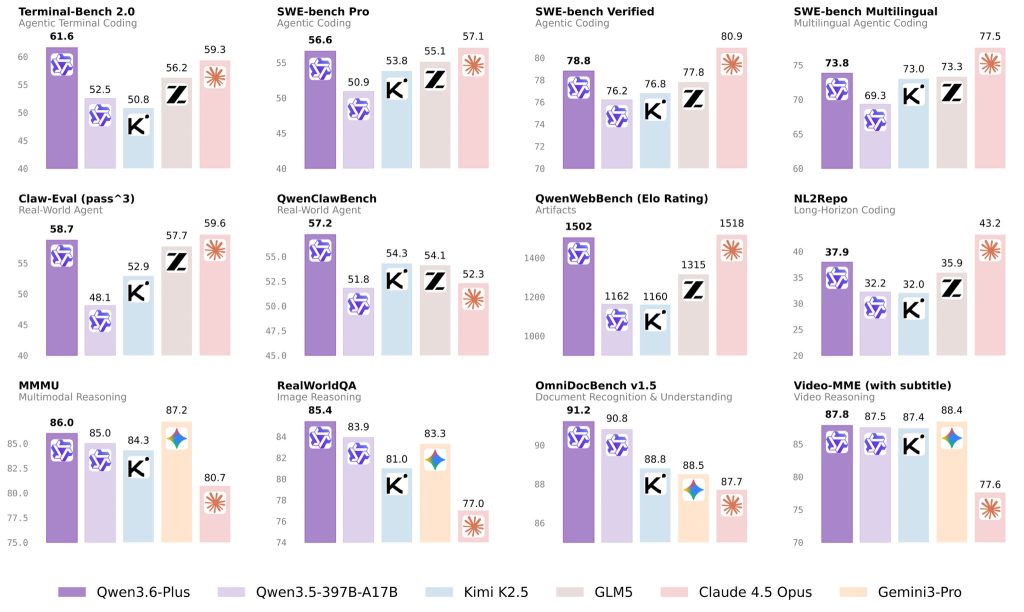

Como interpretar os resultados do benchmark

lançamento do Alibaba relatório de materiais Os resultados publicados pelo fornecedor incluem 78,8 no SWE-bench Verified e 61,6 no Terminal-Bench 2.0. Os mesmos materiais de lançamento também destacam ganhos em avaliações mais amplas de agentes e multimodais no mundo real, portanto, a empresa está claramente apresentando o Qwen3.6-Plus como um modelo otimizado para fluxos de trabalho com alta demanda de execução, em vez de tarefas simples de execução única.

Alguns usuários também questionaram a escolha dos alvos de comparação, perguntando por que o Qwen3.6-Plus não foi comparado diretamente com outros modelos. Claude Opus 4.6 ou Gemini 3.1 ProUma explicação mais provável é o posicionamento do produto. O Qwen3.6-Plus pertence à série Plus, projetada para uso com alta concorrência, portanto, seu conjunto de comparação está mais próximo de modelos como... Claude 4.5 Opus Em termos de cenários de implantação e nível de consumo de computação, os benchmarks selecionados parecem refletir um alinhamento prático do produto, em vez de simplesmente visar os nomes de modelos mais recentes.

Esses números são mais úteis quando combinados com as definições originais dos benchmarks. O SWE-bench avalia se um modelo ou agente consegue resolver problemas reais do GitHub em repositórios reais; o SWE-bench Verified é um subconjunto de 500 tarefas filtradas por humanos; o Terminal-Bench 2.0 mede o desempenho em 89 tarefas complexas de terminal inspiradas em fluxos de trabalho reais; e o OmniDocBench avalia a análise sintática de PDFs em nove fontes de documentos com anotações detalhadas de layout e atributos.

| Referência | O que mede | Por que isso importa |

| Verificado pelo SWE-bench | Resolução de problemas reais de software em bases de código | Útil para avaliar a depuração em nível de repositório e a geração de patches. |

| Bancada de terminais 2.0 | Execução de tarefas de linha de comando em várias etapas | Útil para automação de terminais, configuração de fluxos e confiabilidade de agentes. |

| OmniDocBench | Análise complexa de PDFs e documentos | Útil para artigos técnicos, especificações, tabelas e fórmulas. |

| Avaliações de agentes no mundo real | Planejamento em várias etapas e uso de ferramentas | Útil para a conclusão de fluxos de trabalho de ponta a ponta, em vez de respostas isoladas. |

Um exemplo prático é uma tarefa de engenharia de contexto extenso, na qual o modelo deve ler um grande repositório, identificar os arquivos relevantes, planejar uma correção, executar ações no terminal e verificar o resultado. Outro exemplo é a análise sintática de PDFs técnicos extensos ou documentos com muitas imagens antes de convertê-los em resumos, notas de implementação ou tarefas subsequentes.

Qual é a discussão em torno do Qwen 3.6-Plus?

O momento deste lançamento é importante porque ocorreu logo após a notícia da mudança na liderança da equipe Qwen. Esse contexto, por si só, não comprova uma ruptura estratégica, mas ajuda a explicar por que o lançamento atraiu atenção além das especificações do modelo. Na prática, muitos leitores estão avaliando tanto o produto em si quanto o que ele pode sinalizar sobre a próxima fase da Qwen.

Durante a revisão discussões de desenvolvedores Em diversas comunidades técnicas, notei que o foco principal não estava inteiramente nas pontuações de benchmarks. Em vez disso, grande parte da atenção se concentrava no fato de que o Qwen3.6-Plus está atualmente disponível em um formato hospedado e de código fechado, com acesso limitado a chamadas de API e pré-visualização da plataforma.

Essa reação é compreensível. As versões anteriores do Qwen conquistaram grande boa vontade entre os desenvolvedores por meio de uma abordagem mais aberta, então este lançamento gerou discussões sobre o que essa mudança pode significar na prática.

A primeira preocupação é a implantação local e a privacidade dos dados. Muitos usuários corporativos dependem de modelos abertos para ajustes locais e implantação privada, a fim de atender a requisitos rigorosos de conformidade e segurança. Um modelo fechado, baseado em API, significa que bases de código, documentos ou dados comerciais podem precisar ser processados na nuvem, o que pode dificultar a adoção em setores sensíveis à privacidade, como finanças e saúde.

A segunda preocupação é o ritmo de adaptação do ecossistema e da cadeia de ferramentas. Modelos abertos tendem a gerar plugins da comunidade, variantes quantizadas, fluxos de trabalho de ajuste fino e utilitários de terceiros muito rapidamente. Se a linha principal do Qwen 3.6 permanecer fechada, alguns desenvolvedores podem estar menos dispostos a investir na criação de ferramentas externas e integrações em torno dela.

Uma terceira interpretação é mais comercial do que técnica. Alguns observadores do setor veem isso como um possível sinal da estratégia de monetização mais ampla da Alibaba Cloud: manter seus modelos mais robustos dentro de sua própria plataforma de nuvem para fortalecer a adoção de serviços gerenciados, o uso de APIs e a receita computacional relacionada.

Em geral, isso não necessariamente enfraquece o produto em si. No entanto, altera as compensações. Para equipes que já operam dentro da Alibaba Cloud, o modelo hospedado pode ser conveniente e econômico. Para equipes que priorizam hospedagem própria, governança ou personalização profunda, o modelo de implantação pode ser quase tão importante quanto os resultados dos benchmarks.

Qwen3.6-Plus Parece ser uma opção de hospedagem robusta para desenvolvedores que se preocupam com contexto extenso, fluxos de trabalho de codificação e tarefas de agentes multimodais. Sua ficha técnica oficial é sólida, seus preços são relativamente competitivos na faixa de entrada e os materiais de lançamento da Alibaba a posicionam de forma convincente em categorias de benchmarks que exigem alta capacidade de execução. No entanto, o lançamento em nuvem ainda pode ser uma opção relevante para equipes que preferem modelos de código aberto ou auto-hospedados.